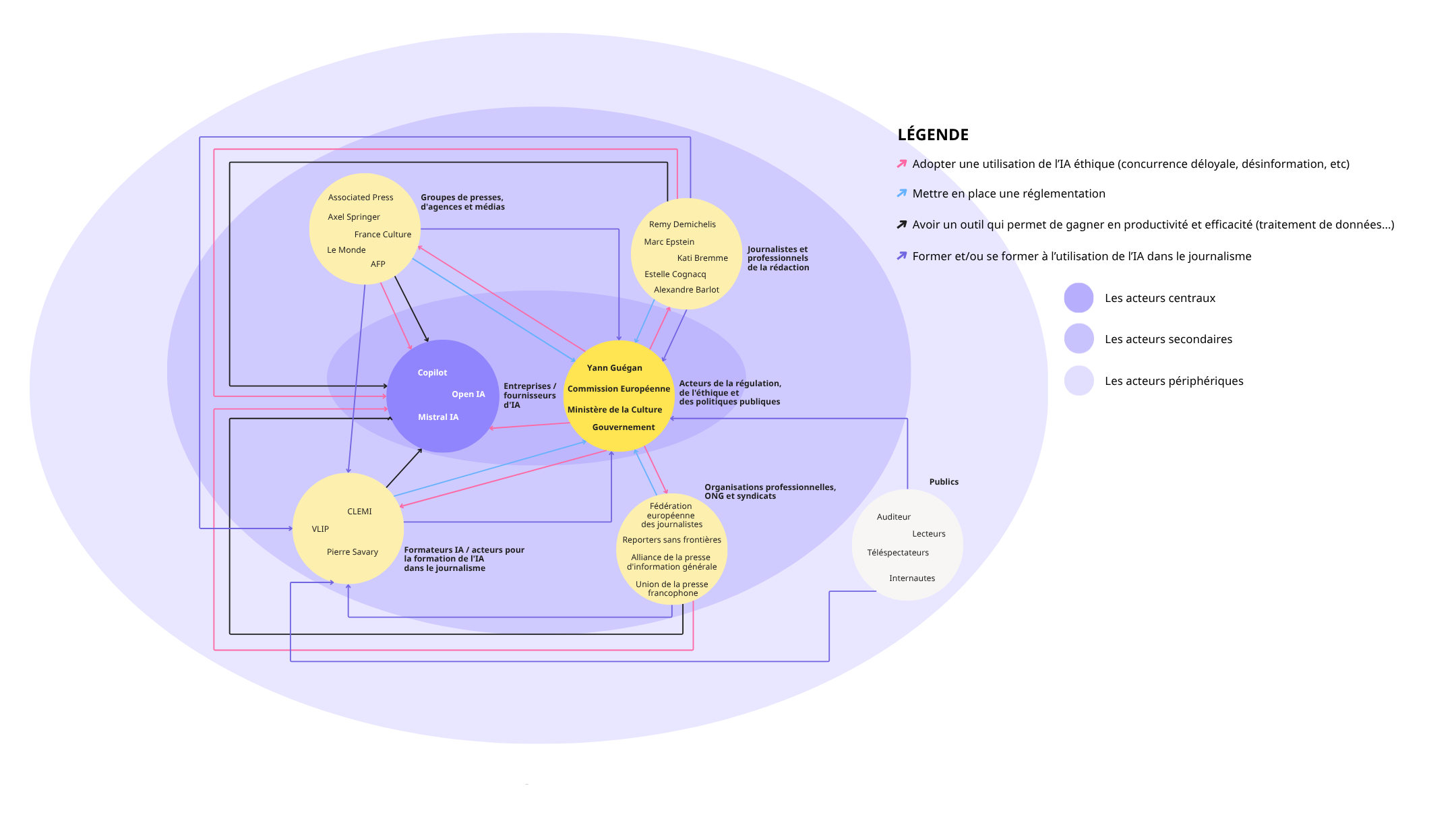

Les acteurs

La cartographie de notre controverse s’avérant particulièrement complexe, nous avons choisi de présenter de manière plus approfondie certains acteurs, en privilégiant ceux qui apparaissent comme les plus pertinents et les plus cohérents au regard de notre sujet, dans les paragraphes suivants.

Il convient de souligner que peu d’acteurs adoptent une position entièrement favorable ou totalement opposée à l’utilisation de l’intelligence artificielle dans le journalisme. La plupart développent en effet des postures ambivalentes, ce qui contribue à renforcer la complexité de cette controverse.

Nous présenterons dans un premier temps la cartographie des acteurs liée à notre sujet, avant d’exposer plus en détail les positions de certains d’entre eux.

Cartographie des acteurs de la controverse

OpenAI : une position officiellement favorable à l’IA comme ressource pour le journalisme, tout en reconnaissant les risques de désinformation

OpenAI se positionne publiquement comme un acteur qui cherche à soutenir le journalisme et non à le remplacer. L’entreprise affirme explicitement que son objectif est de renforcer le rôle des médias dans la diffusion d’une information fiable. Elle déclare notamment que « Le journalisme est essentiel à une démocratie en bonne santé » et qu’elle est « engagée à être un partenaire solide pour les organisations de presse » (OpenAI). Cette déclaration montre clairement que l’entreprise considère le journalisme comme une institution fondamentale et que son IA doit fonctionner comme un outil complémentaire, destiné à renforcer les capacités des journalistes plutôt qu’à les supplanter.

Dans cette perspective, OpenAI multiplie les partenariats avec des médias afin de garantir la diffusion d’informations fiables via ses outils. L’entreprise explique ainsi que ses collaborations avec des organisations comme Le Monde, Axel Springer ou TIME visent à « soutenir un journalisme crédible en accordant une attribution appropriée aux sources originales » (OpenAI). Cette notion d’attribution est centrale : elle vise à répondre aux critiques selon lesquelles l’IA pourrait détourner le contenu journalistique sans reconnaissance ni rémunération. En intégrant des citations et des liens vers les sources originales, OpenAI cherche à préserver le rôle du média comme source d’autorité et à éviter que l’IA ne devienne un producteur autonome d’information non vérifiée.

De plus, OpenAI affirme que ses technologies peuvent renforcer l’écosystème médiatique, notamment en aidant les journalistes à accomplir certaines tâches. L’entreprise explique vouloir « aider les journalistes dans les tâches chronophages » et « renforcer à la fois l’écosystème de l’information et notre produit » (OpenAI). Cette vision présente l’IA comme une ressource permettant d’améliorer la productivité journalistique, notamment pour la recherche, la synthèse d’informations ou l’analyse de données. Dans cette logique, l’IA apparaît comme un outil qui permet aux journalistes de se concentrer davantage sur des tâches à forte valeur ajoutée, comme l’enquête, l’analyse ou l’investigation.

Cependant, OpenAI reconnaît également les risques liés à l’utilisation de l’IA, notamment en matière de désinformation. L’entreprise a ainsi révélé avoir détecté des tentatives d’utilisation de ses outils pour manipuler l’opinion publique, notamment via la génération de faux contenus destinés à influencer des débats politiques. Elle explique que ces opérations visaient « manipuler l’opinion publique ou influencer les résultats politiques » (Reuters). Cette reconnaissance montre que l’entreprise est consciente du potentiel de l’IA à devenir un outil de désinformation, ce qui renforce la dimension controversée de son rôle dans le journalisme.

Malgré ces risques, OpenAI insiste sur le fait que l’IA peut contribuer à améliorer l’accès à une information fiable. Elle affirme que ses partenariats visent à « permettre aux utilisateurs de ChatGPT dans le monde entier de se connecter à l’actualité de nouvelles façons, plus interactives et éclairantes » (OpenAI). Cette déclaration souligne la vision d’OpenAI selon laquelle l’IA ne remplace pas le journalisme, mais transforme la manière dont le public accède à l’information, en facilitant sa diffusion et sa compréhension.

Ainsi, la position d’OpenAI dans la controverse est fondamentalement favorable à l’IA, qu’elle considère comme une ressource pour le journalisme, mais cette position reste nuancée par la reconnaissance des risques liés à la désinformation et à la manipulation. L’entreprise cherche à se présenter comme un partenaire des médias, tout en développant une technologie qui transforme profondément leur fonctionnement.

Laurent Hue (Ouest-France) : une position favorable mais encadrée, où l’IA est une ressource productive qui nécessite un contrôle humain strict

Laurent Hue, responsable de la stratégie IA du groupe Ouest-France, adopte une position clairement favorable à l’intégration de l’intelligence artificielle dans le journalisme, tout en soulignant la nécessité d’un encadrement rigoureux. Il considère l’IA avant tout comme un outil permettant d’améliorer le travail journalistique, notamment dans le traitement de données massives et l’automatisation de certaines tâches répétitives. Il explique que l’intelligence artificielle permet de « libérer du temps journalistique pour des tâches à plus forte valeur ajoutée comme l’enquête ou le reportage » (Ouest-France). Cette déclaration montre que l’IA est perçue comme une ressource qui permet aux journalistes de se concentrer sur leur mission fondamentale : produire une information originale et vérifiée.

Toutefois, Laurent Hue insiste sur le fait que l’IA ne peut en aucun cas remplacer le jugement journalistique. Il rappelle que « la responsabilité éditoriale reste humaine » (Ouest-France). Cette affirmation est essentielle dans la controverse, car elle souligne que l’IA ne doit pas être considérée comme une source autonome d’information, mais comme un outil assisté par des professionnels. Cette position reflète une vision nuancée : l’IA est bénéfique, mais uniquement si elle reste sous le contrôle des journalistes.

Laurent Hue met également en avant les risques liés à la désinformation. Il souligne que l’IA peut produire des contenus erronés ou trompeurs si elle n’est pas correctement supervisée. Cette préoccupation s’inscrit dans une réflexion plus large sur la crédibilité des médias à l’ère numérique. Pour lui, l’enjeu n’est pas seulement technologique, mais aussi éthique : il s’agit de préserver la confiance du public dans l’information.

Ainsi, Laurent Hue défend une position nuancée dans la controverse. Il considère l’IA comme une ressource essentielle pour moderniser le journalisme et améliorer son efficacité, mais il insiste sur la nécessité de maintenir un contrôle humain strict afin d’éviter les dérives liées à la désinformation.

Kati Bremme (France Télévisions) : l’IA comme levier d’innovation, mais avec un enjeu majeur de confiance et de fiabilité de l’information

Kati Bremme, directrice de l’innovation et de la prospective à France Télévisions, considère l’intelligence artificielle comme une opportunité majeure pour transformer le journalisme et améliorer la production d’information. Elle explique que l’IA permet notamment de « faciliter le travail des journalistes en automatisant certaines tâches » (France Télévisions). Cette vision met en avant le rôle de l’IA comme ressource technologique permettant d’améliorer l’efficacité des rédactions.

Elle souligne également que l’IA permet d’améliorer l’accessibilité de l’information, notamment grâce à la traduction automatique et à la transcription. Ces outils permettent de rendre les contenus plus accessibles à un public plus large, ce qui renforce la mission de service public de France Télévisions.

Cependant, Kati Bremme reconnaît que l’IA pose également des défis importants, notamment en matière de confiance. Elle insiste sur la nécessité de maintenir un contrôle éditorial strict afin de garantir la fiabilité de l’information. Cette préoccupation reflète une inquiétude centrale dans la controverse : l’IA peut produire des contenus crédibles mais faux, ce qui peut fragiliser la confiance du public dans les médias.

Sa position est donc clairement nuancée : elle soutient l’intégration de l’IA dans le journalisme, mais insiste sur la nécessité d’un encadrement humain afin de préserver la qualité et la crédibilité de l’information.

Toutefois, Laurent Hue insiste sur le fait que l’IA ne peut en aucun cas remplacer le jugement journalistique. Il rappelle que « la responsabilité éditoriale reste humaine » (Ouest-France). Cette affirmation est essentielle dans la controverse, car elle souligne que l’IA ne doit pas être considérée comme une source autonome d’information, mais comme un outil assisté par des professionnels. Cette position reflète une vision nuancée : l’IA est bénéfique, mais uniquement si elle reste sous le contrôle des journalistes.

Laurent Hue met également en avant les risques liés à la désinformation. Il souligne que l’IA peut produire des contenus erronés ou trompeurs si elle n’est pas correctement supervisée. Cette préoccupation s’inscrit dans une réflexion plus large sur la crédibilité des médias à l’ère numérique. Pour lui, l’enjeu n’est pas seulement technologique, mais aussi éthique : il s’agit de préserver la confiance du public dans l’information.

Ainsi, Laurent Hue défend une position nuancée dans la controverse. Il considère l’IA comme une ressource essentielle pour moderniser le journalisme et améliorer son efficacité, mais il insiste sur la nécessité de maintenir un contrôle humain strict afin d’éviter les dérives liées à la désinformation.

Le Monde : une position pragmatique, où l’IA est une ressource utile mais potentiellement dangereuse pour la fiabilité de l’information

Le journal Le Monde adopte une position nuancée dans la controverse. Le média utilise l’IA pour améliorer son fonctionnement, notamment dans le traitement de données et la modération des contenus. Le Monde reconnaît que l’intelligence artificielle peut améliorer l’efficacité journalistique, notamment en facilitant certaines tâches techniques.

Cependant, le journal souligne également les dangers liés à cette technologie, notamment en matière de désinformation. Il explique que l’IA peut produire des contenus « faux mais plausibles », ce qui constitue une menace majeure pour l’information fiable (Le Monde). Cette caractéristique rend la désinformation particulièrement difficile à détecter, car les contenus générés par l’IA peuvent sembler crédibles.

Le Monde insiste également sur la nécessité de maintenir le rôle central des journalistes dans la production d’information. Le journal considère que l’IA doit rester un outil, et non un substitut au travail journalistique.

Ainsi, Le Monde adopte une position nuancée : il reconnaît les avantages de l’IA, mais met en garde contre ses dangers pour la fiabilité de l’information.

Radio France : une position équilibrée entre innovation technologique et protection de la fiabilité journalistique

Radio France utilise l’intelligence artificielle pour améliorer ses processus de production, notamment dans la transcription et l’archivage des contenus. L’organisation considère que l’IA permet d’améliorer l’efficacité du travail journalistique.

Cependant, Radio France insiste sur le fait que l’IA ne peut pas remplacer le jugement journalistique. L’organisation affirme que « l’IA est un outil au service des journalistes, pas un substitut » (Radio France). Cette déclaration souligne clairement que l’IA est considérée comme une ressource, mais qu’elle ne doit pas remplacer les professionnels.

Radio France reconnaît également les risques liés à la désinformation. L’organisation souligne que l’IA peut être utilisée pour produire de faux contenus, ce qui constitue une menace pour la fiabilité de l’information.

Ainsi, Radio France adopte une position nuancée, reconnaissant les avantages de l’IA tout en soulignant ses risques.

Reporters sans frontières : une position critique, qui considère l’IA comme une menace potentielle pour la fiabilité de l’information

Reporters sans frontières adopte une position particulièrement vigilante face à l’intelligence artificielle, qu’elle considère comme une technologie pouvant fragiliser profondément l’écosystème de l’information. L’organisation souligne que l’IA facilite la production massive de contenus trompeurs, ce qui constitue un danger majeur pour la fiabilité de l’information. Elle explique notamment que l’intelligence artificielle permet la production de contenus synthétiques capables de « diffuser à grande échelle des contenus manipulés » (Reporters sans frontières). Cette capacité constitue une rupture majeure dans l’histoire de la désinformation, car elle permet d’automatiser et d’industrialiser la production de fake news.

Reporters sans frontières insiste également sur le fait que ces technologies peuvent être utilisées pour manipuler l’opinion publique. Elle souligne que les systèmes d’IA générative peuvent produire des contenus crédibles mais faux, ce qui rend la désinformation plus difficile à détecter. Cette caractéristique constitue une menace directe pour la démocratie, car elle fragilise la capacité des citoyens à accéder à une information fiable.

Cependant, Reporters sans frontières reconnaît également que l’IA peut constituer une ressource pour le journalisme. L’organisation souligne que ces technologies peuvent être utilisées pour analyser de grandes quantités de données ou détecter la désinformation. Elle insiste toutefois sur la nécessité de réguler ces technologies afin de limiter leurs effets négatifs.

Ainsi, la position de Reporters sans frontières est profondément nuancée : l’IA constitue à la fois une ressource pour le journalisme et une menace majeure pour la fiabilité de l’information.

Commission européenne : une position de régulation visant à protéger la démocratie face aux risques de manipulation de l’information

La Commission européenne considère l’intelligence artificielle comme une technologie présentant à la fois des opportunités et des risques majeurs. Elle souligne que l’IA peut améliorer l’accès à l’information, mais qu’elle peut également être utilisée pour produire de la désinformation. La Commission explique que l’IA constitue « une technologie en évolution rapide qui peut apporter de nombreux avantages » (Commission européenne).

Cependant, elle souligne également que l’IA pose des risques importants, notamment en matière de désinformation. Elle explique que l’objectif de la réglementation européenne est de « garantir que l’IA respecte les droits fondamentaux et la démocratie » (Commission européenne).

La position de la Commission européenne est donc nuancée.

Agence France-Presse (AFP) : une position favorable à l’IA comme ressource journalistique, mais avec une vigilance forte face aux risques de désinformation

L’Agence France-Presse adopte une position nuancée dans la controverse, en considérant l’intelligence artificielle comme un outil utile pour renforcer le travail journalistique, tout en reconnaissant les risques importants qu’elle pose pour la fiabilité de l’information. L’AFP utilise l’IA notamment dans le traitement automatisé de données, ce qui permet d’améliorer l’efficacité de la production d’informations. L’agence explique que l’automatisation permet de produire rapidement des contenus factuels, notamment dans les domaines financiers ou sportifs, ce qui constitue un gain de temps considérable pour les journalistes.

Cependant, l’AFP souligne également que l’intelligence artificielle représente une menace majeure en matière de désinformation. L’agence insiste sur le fait que les contenus générés par l’IA peuvent être utilisés pour produire de fausses informations crédibles. Elle rappelle que son rôle est précisément de lutter contre ce phénomène, en vérifiant les informations diffusées en ligne. L’AFP explique ainsi que la prolifération de contenus générés par l’IA « rend le travail de vérification plus important que jamais » (AFP Factuel). Cette déclaration montre que l’IA constitue à la fois un outil utile et une source de nouveaux risques.

L’agence insiste également sur le fait que le journalisme repose sur des principes fondamentaux, notamment la vérification des sources et la responsabilité éditoriale. Ces principes ne peuvent pas être remplacés par l’IA. Ainsi, l’AFP considère que l’intelligence artificielle doit rester un outil au service des journalistes, et non un substitut à leur travail.

La position de l’AFP est donc clairement nuancée : elle reconnaît les avantages de l’IA pour améliorer l’efficacité journalistique, tout en mettant en garde contre ses dangers en matière de désinformation.

TF1 : une position favorable à l’IA comme outil d’amélioration du journalisme, avec un encadrement humain essentiel

Le groupe TF1 utilise l’intelligence artificielle pour améliorer ses processus de production et de diffusion de l’information. Laure Bezault, secrétaire générale de l’information du groupe, explique que l’IA permet d’améliorer l’efficacité du travail journalistique, notamment dans la gestion des contenus et la production d’informations.

TF1 considère que l’IA constitue un outil permettant de renforcer la capacité des journalistes à produire de l’information. Elle permet notamment d’automatiser certaines tâches techniques, ce qui libère du temps pour les journalistes. Cette utilisation montre que l’IA est perçue comme une ressource permettant d’améliorer la qualité du journalisme.

Cependant, TF1 insiste sur le fait que l’IA ne peut pas remplacer le jugement journalistique. Le groupe souligne que « les journalistes restent responsables de l’information diffusée » (TF1). Cette déclaration montre clairement que l’IA est considérée comme un outil assisté par l’humain, et non comme un producteur autonome d’information.

TF1 reconnaît également les risques liés à la désinformation. Le groupe souligne que l’IA peut être utilisée pour produire de fausses informations, ce qui constitue un défi majeur pour les médias.

Ainsi, la position de TF1 est nuancée : l’IA est une ressource utile, mais elle doit être utilisée avec précaution.

Institut national de l’audiovisuel (INA) : une position favorable à l’IA comme outil de valorisation et d’exploitation de l’information

L’Institut national de l’audiovisuel adopte une position globalement favorable à l’intelligence artificielle, qu’il considère comme un outil essentiel pour exploiter et valoriser les contenus audiovisuels. L’INA utilise l’IA pour analyser, indexer et exploiter ses archives.

Xavier Lemarchand explique que l’IA permet de « mieux exploiter les archives audiovisuelles » (INA). Cette capacité constitue une ressource importante pour les journalistes, car elle facilite l’accès à des contenus historiques.

Antoine Bayet souligne également que l’IA permet de transformer la manière dont l’information est produite et diffusée. Il explique que ces technologies permettent d’améliorer l’accès à l’information.

Cependant, l’INA reconnaît que l’IA pose également des défis, notamment en matière de fiabilité de l’information. L’institution souligne la nécessité de maintenir un contrôle humain sur les contenus générés par l’IA.

Ainsi, la position de l’INA est favorable mais reste nuancée.

Axel Springer : une position très favorable à l’IA comme ressource stratégique pour l’avenir du journalisme

Le groupe Axel Springer adopte une position très favorable à l’intelligence artificielle, qu’il considère comme une technologie essentielle pour l’avenir du journalisme. Le groupe a établi un partenariat stratégique avec OpenAI afin d’intégrer l’IA dans ses activités.

Axel Springer explique que ce partenariat vise à « renforcer le journalisme indépendant à l’ère numérique » (Axel Springer). Cette déclaration montre que le groupe considère l’IA comme une ressource permettant de renforcer le journalisme.

Le groupe souligne également que l’IA permet d’améliorer la diffusion de l’information et d’atteindre un public plus large.

Cependant, Axel Springer reconnaît que l’IA pose des défis, notamment en matière de transformation du métier de journaliste.

Sa position est donc clairement favorable.

Pierre Savary (École supérieure de journalisme de Lille) : une position nuancée, où l’IA constitue à la fois une opportunité pédagogique majeure et un défi pour la crédibilité et l’intégrité du journalisme

Pierre Savary, directeur de l’École supérieure de journalisme de Lille, adopte une position profondément nuancée face à l’intelligence artificielle, qu’il considère comme une transformation structurelle du métier de journaliste et de sa formation. Selon lui, l’IA constitue d’abord une opportunité pédagogique essentielle, car elle modifie les compétences nécessaires à l’exercice du journalisme. Il souligne que les écoles doivent désormais former les étudiants à ces nouveaux outils afin de les préparer aux réalités du métier. Il explique notamment que « les étudiants doivent comprendre comment fonctionnent ces outils, leurs limites, et leurs biais » (École supérieure de journalisme de Lille). Cette déclaration montre que l’IA n’est pas seulement un outil technique, mais un objet d’apprentissage critique, qui nécessite une compréhension approfondie pour être utilisé de manière responsable.

Pierre Savary insiste également sur le fait que l’intelligence artificielle transforme profondément les pratiques journalistiques, notamment en facilitant l’accès à l’information et en accélérant certaines tâches. Il souligne que ces outils peuvent aider les journalistes à traiter de grandes quantités de données et à améliorer leur efficacité. Cette capacité constitue une ressource importante dans un contexte où les rédactions sont confrontées à une accélération du rythme de production de l’information. L’IA peut ainsi contribuer à améliorer la productivité journalistique, notamment dans la recherche documentaire, la transcription ou la synthèse d’informations.

Cependant, Pierre Savary met également en garde contre les risques que l’IA pose pour la crédibilité du journalisme. Il souligne que ces outils peuvent produire des informations erronées ou trompeuses, ce qui constitue un danger majeur pour la fiabilité de l’information. Il explique notamment que les journalistes doivent apprendre à vérifier les contenus générés par l’IA et à ne pas leur accorder une confiance excessive. Cette mise en garde s’inscrit dans une réflexion plus large sur la responsabilité journalistique à l’ère de l’intelligence artificielle.

Il insiste également sur le fait que l’IA ne peut pas remplacer le rôle fondamental des journalistes, notamment en matière de vérification et d’analyse critique. Le journalisme repose sur des compétences humaines essentielles, comme le jugement, l’éthique et la capacité à contextualiser l’information. Ces compétences ne peuvent pas être reproduites par une machine.

Ainsi, la position de Pierre Savary est clairement nuancée dans la controverse. Il considère l’intelligence artificielle comme une ressource pédagogique et professionnelle majeure, qui transforme profondément le journalisme, mais il souligne également qu’elle constitue un risque potentiel pour la crédibilité de l’information si elle est utilisée sans esprit critique et sans encadrement.

Mistral AI : une position fortement favorable à l’IA, présentée comme un outil stratégique pour renforcer le journalisme et la souveraineté informationnelle européenne

Mistral AI adopte une position clairement favorable à l’intelligence artificielle, qu’elle considère comme une technologie essentielle pour l’avenir de l’information et du journalisme. L’entreprise présente ses modèles comme des outils permettant d’améliorer la production et l’accès à l’information. Elle explique que son objectif est de « mettre l’IA de pointe entre les mains de tous » (Mistral AI). Cette déclaration montre que l’entreprise considère l’intelligence artificielle comme une technologie capable de démocratiser l’accès à l’information et de transformer les pratiques professionnelles, notamment dans le journalisme.

Mistral AI souligne également que ses technologies permettent d’améliorer la productivité des professionnels de l’information. Les modèles d’IA peuvent aider à analyser de grandes quantités de données, à produire des synthèses ou à assister les journalistes dans leurs recherches. Cette capacité constitue une ressource importante dans un contexte où les journalistes doivent traiter un volume croissant d’informations.

L’entreprise insiste également sur la dimension stratégique de l’intelligence artificielle, notamment en matière de souveraineté informationnelle. Elle explique que l’Europe doit développer ses propres technologies afin de ne pas dépendre exclusivement d’acteurs étrangers. Cette dimension est particulièrement importante dans le domaine de l’information, où les technologies d’IA jouent un rôle croissant.

Cependant, la position de Mistral AI s’inscrit dans une logique technologique qui tend à mettre en avant les avantages de l’IA, sans toujours insister sur ses risques. Cette position reflète les intérêts économiques et stratégiques de l’entreprise, qui développe ces technologies.

Ainsi, la position de Mistral AI dans la controverse est clairement favorable : l’entreprise considère l’IA comme une ressource essentielle pour améliorer le journalisme et renforcer la souveraineté technologique européenne.

Microsoft Copilot : une position favorable à l’IA comme outil d’assistance permettant d’augmenter les capacités des journalistes, tout en reconnaissant la nécessité d’un usage responsable

Microsoft adopte une position clairement favorable à l’intelligence artificielle, qu’elle présente comme un outil permettant d’assister les professionnels, y compris les journalistes. Microsoft explique que Copilot est conçu pour « aider les gens à générer, résumer et analyser du contenu » (Microsoft). Cette déclaration montre que l’IA est présentée comme un outil permettant d’améliorer la productivité et l’efficacité des professionnels de l’information.

Microsoft insiste sur le fait que Copilot ne remplace pas les professionnels, mais qu’il les assiste. L’entreprise explique que l’objectif est d’augmenter les capacités humaines, et non de les remplacer. Cette approche correspond à une vision dite d’« intelligence augmentée », dans laquelle l’IA fonctionne comme un outil au service de l’humain.

Copilot permet notamment d’aider les journalistes à synthétiser des documents, à analyser des données ou à rédiger certains contenus. Ces capacités constituent une ressource importante dans un contexte où les journalistes doivent traiter rapidement de grandes quantités d’informations.

Cependant, Microsoft reconnaît également les limites de ces technologies. L’entreprise souligne que les contenus générés par l’IA doivent être vérifiés, car ils peuvent contenir des erreurs. Elle explique que « le contenu généré par l’IA peut être incorrect » (Microsoft). Cette reconnaissance montre que l’entreprise est consciente des risques liés à l’utilisation de l’IA.

Cette position reflète une stratégie visant à promouvoir l’IA tout en reconnaissant ses limites. Microsoft cherche à présenter Copilot comme un outil fiable, tout en insistant sur la nécessité d’un usage responsable.

Ainsi, la position de Microsoft dans la controverse est favorable mais nuancée : l’entreprise considère l’IA comme une ressource permettant d’améliorer le journalisme, mais reconnaît qu’elle doit être utilisée avec prudence afin d’éviter la diffusion d’informations erronées.

France Télévisions : une position nuancée, où l’IA constitue une innovation utile mais qui doit rester sous contrôle humain

France Télévisions adopte une position équilibrée face à l’intelligence artificielle, qu’elle considère comme une innovation majeure pour le journalisme, tout en reconnaissant ses dangers. Pascal Doucet-Bon souligne que l’IA permet d’améliorer la production d’information en automatisant certaines tâches. Il explique que ces technologies permettent notamment d’améliorer l’efficacité des rédactions et de faciliter le traitement de l’information.

Christophe de Vallambras, chef du MediaLab de France Télévisions, explique que l’IA constitue un outil permettant d’améliorer l’accès à l’information et de faciliter le travail journalistique. Il souligne que ces technologies permettent notamment d’analyser rapidement de grandes quantités de données.

Cependant, France Télévisions insiste sur le fait que l’IA ne peut pas remplacer les journalistes. Éric Scherer explique que « l’intelligence artificielle ne remplace pas les journalistes mais les assiste » (France Télévisions). Cette déclaration souligne clairement que l’IA est considérée comme un outil au service du journalisme, et non comme un substitut.

France Télévisions reconnaît également les risques liés à la désinformation. L’organisation souligne que l’IA peut être utilisée pour produire de fausses informations, ce qui constitue un défi majeur pour les médias.

Ainsi, la position de France Télévisions est nuancée : l’IA constitue une ressource utile, mais elle doit être utilisée avec prudence.

Le Figaro : une position pragmatique et stratégique, où l’IA constitue une ressource pour la production journalistique, tout en représentant un risque pour la crédibilité de l’information

Le Figaro adopte une position pragmatique face à l’intelligence artificielle, qu’il considère comme une innovation technologique majeure capable de transformer profondément le journalisme. Le journal utilise notamment l’IA pour automatiser certaines tâches éditoriales et améliorer la gestion des contenus. Cette intégration s’inscrit dans une stratégie globale visant à moderniser la production d’information et à améliorer la compétitivité du média dans un environnement numérique fortement concurrentiel. Comme l’explique Le Figaro, « l’intelligence artificielle permet notamment d’automatiser certaines tâches répétitives et d’assister les journalistes dans leurs recherches » (Le Figaro). Cette déclaration montre clairement que le média considère l’IA comme une ressource permettant d’améliorer l’efficacité journalistique, notamment en réduisant le temps consacré à certaines tâches techniques.

Cependant, Le Figaro reconnaît également que cette technologie pose des risques importants pour la fiabilité de l’information. Le journal souligne notamment que les outils d’intelligence artificielle générative, comme ChatGPT, peuvent produire des contenus crédibles mais erronés. Cette caractéristique rend la désinformation particulièrement dangereuse, car elle devient plus difficile à détecter. En effet, les contenus générés par l’IA peuvent imiter le style journalistique et donner l’impression d’être fiables, même lorsqu’ils contiennent des erreurs.

Le Figaro insiste également sur le fait que le journalisme repose sur des principes fondamentaux qui ne peuvent pas être remplacés par l’IA, notamment la vérification des sources et la responsabilité éditoriale. Le journal souligne que les journalistes restent indispensables pour garantir la fiabilité de l’information.

Ainsi, la position du Figaro dans la controverse est clairement nuancée : le média considère l’IA comme une ressource stratégique pour améliorer le journalisme, mais reconnaît également qu’elle constitue une menace potentielle pour la crédibilité de l’information si elle n’est pas utilisée avec précaution.

Ministère de la Culture : une position institutionnelle de régulation visant à protéger l’écosystème de l’information face aux risques de désinformation liés à l’IA

Le Ministère de la Culture adopte une position centrée sur la régulation et la protection de l’écosystème médiatique face aux transformations liées à l’intelligence artificielle. L’institution reconnaît que l’IA constitue une innovation majeure susceptible d’améliorer la production et la diffusion de l’information, mais elle souligne également les risques importants que cette technologie pose pour la fiabilité de l’information. Le ministère explique notamment que l’intelligence artificielle représente « un enjeu majeur pour les industries culturelles et créatives » (Ministère de la Culture). Cette déclaration montre que l’IA est perçue comme une technologie capable de transformer profondément le secteur médiatique.

Cependant, le ministère insiste également sur la nécessité de protéger l’information fiable et de lutter contre la désinformation. Il souligne que l’IA peut être utilisée pour produire et diffuser de fausses informations, ce qui constitue une menace pour la démocratie. Le ministère explique que l’un des objectifs des politiques publiques est de « garantir un environnement numérique de confiance » (Ministère de la Culture). Cette notion de confiance est centrale dans la controverse, car elle souligne l’importance de préserver la crédibilité de l’information dans un contexte où l’IA facilite la production de contenus trompeurs.

Le ministère insiste également sur la nécessité de réguler l’utilisation de l’IA afin de protéger les médias et les citoyens. Cette position reflète une approche institutionnelle visant à encadrer le développement de ces technologies afin de limiter leurs effets négatifs.

Ainsi, la position du Ministère de la Culture est clairement nuancée : l’IA constitue une ressource pour le développement du secteur médiatique, mais elle représente également un risque important qui nécessite une régulation.

Conseil de déontologie journalistique et de médiation (CDJM) - Yann Guégan : une position critique visant à préserver l’intégrité et la crédibilité du journalisme

Le Conseil de déontologie journalistique et de médiation adopte une position particulièrement vigilante face à l’intelligence artificielle, qu’il considère comme une technologie susceptible de fragiliser les principes fondamentaux du journalisme. Yann Guégan souligne que l’IA pose des défis majeurs en matière de crédibilité de l’information. Il explique notamment que « l’usage de l’intelligence artificielle dans la production journalistique doit respecter les règles déontologiques » (CDJM). Cette déclaration souligne que l’IA ne peut pas être utilisée librement sans encadrement, car elle peut compromettre la fiabilité de l’information.

Le CDJM insiste également sur le fait que le journalisme repose sur des principes fondamentaux, notamment la responsabilité éditoriale et la vérification des sources. Ces principes sont essentiels pour garantir la fiabilité de l’information. L’institution souligne que les journalistes doivent rester responsables des contenus produits, même lorsque l’IA est utilisée.

Le CDJM reconnaît également que l’IA peut être utilisée pour produire des contenus trompeurs, ce qui constitue un risque majeur pour la crédibilité des médias.

La position du CDJM est donc clairement critique et vigilante.

Le public (lecteurs, internautes, auditeurs, téléspectateurs) : une position ambivalente entre méfiance face aux fake news et intérêt pour les possibilités offertes par l’IA

Le public constitue un acteur central dans la controverse sur l’intelligence artificielle et le journalisme, car il est à la fois le destinataire de l’information et la cible potentielle de la désinformation. Les études montrent que les citoyens expriment à la fois un intérêt pour les possibilités offertes par l’IA et une inquiétude face aux risques qu’elle pose pour la fiabilité de l’information. Une étude du Reuters Institute montre notamment que « les gens s’inquiètent de ne plus savoir ce qui est réel et ce qui est faux sur Internet » (Reuters Institute). Cette déclaration souligne que la désinformation constitue une préoccupation majeure pour le public.

Le public exprime également des inquiétudes face à l’utilisation de l’IA dans le journalisme. Les citoyens craignent que l’IA puisse produire de fausses informations crédibles, ce qui rend plus difficile la distinction entre information fiable et désinformation.

Cependant, le public reconnaît également les avantages de l’IA, notamment en matière d’accès à l’information.

La position du public est donc ambivalente.